小林聡美

名前:小林 聡美(こばやし さとみ) ニックネーム:さと・さとみん 年齢:25歳 性別:女性 職業:季節・暮らし系ブログを運営するブロガー/たまにライター業も受注 居住地:東京都杉並区・阿佐ヶ谷の1Kアパート(築15年・駅徒歩7分) 出身地:長野県松本市(自然と山に囲まれた町で育つ) 身長:158cm 血液型:A型 誕生日:1999年5月12日 趣味: ・カフェで執筆&読書(特にエッセイと季節の暮らし本) ・季節の写真を撮ること(桜・紅葉・初雪など) ・和菓子&お茶めぐり ・街歩きと神社巡り ・レトロ雑貨収集 ・Netflixで癒し系ドラマ鑑賞 性格:落ち着いていると言われるが、心の中は好奇心旺盛。丁寧でコツコツ型、感性豊か。慎重派だけどやると決めたことはとことん追求するタイプ。ちょっと天然で方向音痴。ひとり時間が好きだが、人の話を聞くのも得意。 1日のタイムスケジュール(平日): 時間 行動 6:30 起床。白湯を飲んでストレッチ、ベランダから天気をチェック 7:00 朝ごはん兼SNSチェック(Instagram・Xに季節の写真を投稿することも) 8:00 自宅のデスクでブログ作成・リサーチ開始 10:30 近所のカフェに移動して作業(記事執筆・写真整理) 12:30 昼食。カフェかコンビニおにぎり+味噌汁 13:00 午後の執筆タイム。主に記事の構成づくりや装飾、アイキャッチ作成など 16:00 夕方の散歩・写真撮影(神社や商店街。季節の風景探し) 17:30 帰宅して軽めの家事(洗濯・夕飯準備) 18:30 晩ごはん&YouTube or Netflixでリラックス 20:00 投稿記事の最終チェック・予約投稿設定 21:30 読書や日記タイム(今日の出来事や感じたことをメモ) 23:00 就寝前のストレッチ&アロマ。23:30に就寝

ファインチューニングとプロンプトエンジニアリングの違いを徹底解説

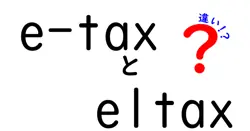

ファインチューニングとプロンプトエンジニアリングは、AIを使うときの出発点となる考え方の違いです。ファインチューニングはモデルの内部パラメータをデータに合わせて微調整する作業で、データの質と量が結果を大きく左右します。プロンプトエンジニアリングは、モデル自体を変えずに入力文の工夫で出力を変える技術です。これらの違いを正しく理解することは、AI活用の現場で最適な手法を選ぶ第一歩です。

この2つは共通点もあります。どちらも「出力をどのようにしてください」という伝え方の設計であり、最終的なゴールは人が求める情報を正確に、わかりやすく、活用しやすい形で得ることです。

ただし、実際には適用する状況が異なります。ファインチューニングは大きな性能改善を狙える反面、長い準備期間や高い計算資源が必要になることが多いです。一方、プロンプトエンジニアリングはすぐに試せて、変更量も小さく済むことが多いですが、最終的な性能はプロンプトの品質に依存します。

このように、短期と長期、柔軟性と安定性、コストと品質のバランスを考えながら使い分けることが現代のAI活用の鉄則です。

ファインチューニングとは何か

ファインチューニングとは、既存の大規模モデルを、あなたの目的に合わせて「もう少しだけ」学習させる作業です。データセットを用意し、学習率を調整し、エポック回数を設定し、モデルのパラメータを少しずつ更新します。

このプロセスでは、モデルの内部パラメータが変わるため、出力の傾向が根本的に変わることがあります。

良いデータを使えば高い精度が得られますが、悪いデータや偏ったデータを使うと、望ましくない出力を招くことがあります。

コスト面では計算資源とデータの質が鍵となり、データクリーニングや検証の工程が重要です。

この方法は、医療や法律、金融のように専門性が高い分野や、長期的な最適化が必要な場面で役立つことが多いです。

実務での実装には、データの整合性を保つ仕組みと、評価用データセットの作成が欠かせません。過学習を防ぐための検証データの活用や、データの偏りをチェックする統計手法、そして責任ある開発の観点からのセキュリティ対策も重要です。

また、クラウド上のGPUリソースを用いる場合には、コスト制限と実行時間の最適化が課題になります。

このような要素を組み合わせることで、ファインチューニングは「専門性の高い出力」を安定して提供できるようになります。

プロンプトエンジニアリングとは何か

プロンプトエンジニアリングとは、モデルを再学習させず、入力文の構造や言い回しを工夫して出力を変える技術です。指示の形式、例示の配置、制約条件の付け方、連続的な対話の設計などを工夫します。

このアプローチの魅力は、学習コストが低く、試せるアイデアが多い点です。新しいタスクが出てきても、プロンプトを工夫するだけで対応できる場面が多くあります。

注意点としては、プロンプトの品質が出力の品質を直接左右する点です。曖昧な指示や不足している情報は、信頼性の低い結果につながります。

経験を積むと、同じモデルでもトーン、要約の長さ、情報の優先順位などを自在にコントロールできるようになり、迅速な検証サイクルを回せるようになります。

プロンプトエンジニアリングは、タスクの設計や言語の選択、出力形式の指定など、対話の工夫次第で大きく結果を変えます。試行と改善を繰り返す学習プロセスとして捉えると、初心者でも段階的に上達しやすいのが特徴です。データを追加せずとも、表現を変えるだけで満足のいく出力が得られることも多く、日常の業務改善や教育現場での活用範囲が広がっています。

実務での使い分けと注意点

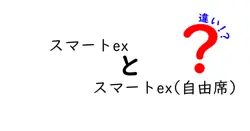

実務では、目的とリソースに応じて「ファインチューニング」と「プロンプトエンジニアリング」を組み合わせることが多いです。

初期はプロンプトエンジニアリングで試作を速く進め、要件が安定してきたらファインチューニングを検討します。

重要な点はデータ品質と評価方法です。

データの偏りを避けるため、サンプルを多様に集め、評価指標を明確に設定することが大切です。

また、エンタープライズ環境ではコスト、セキュリティ、運用性も考える必要があります。

日常的なタスクであれば、まずプロンプトの改善を繰り返し、成果が見えたら段階的にファインチューニングを追加するのが合理的です。

実務での注意点としては、成果を測る「定量的な指標」を設定すること、検証データを用いて継続的な評価を行うこと、そして倫理的・法的リスクを忘れないことです。

モデルの出力がどのような境界で正しいのか、どの程度の創造性を許容するのか、そうした設計 decisions をチームで共有することが大切です。

このような取り組みを通じて、AIを活用する現場はより安定し、利用者にとって価値の高い成果物を生み出すことができます。

ある日、友だちと家でAIの話をしていて、私がファインチューニングって何だろうと尋ねた。友だちは『それは、AIの“中身”を少しだけ書き換える作業だよ』と教えてくれた。私は『新しいデータを教えるの?それでどうなるの?』とさらに質問した。友だちは具体的に、数学の先生が新しい練習問題を加えるような感覚だと説明してくれた。データを増やしてうまく組み合わせれば、AIは自分の専門分野を深め、より正確に答えられるようになる。僕らは、同じレシピでも材料を少し変えるだけで味が違うように、データの選び方次第でAIの出力が大きく変わると納得した。プロンプトエンジニアリングは“どう伝えるか”の工夫で、ファインチューニングは“何を教えるか”の工夫だと理解した。これからの学習でも、この二つの使い分けを意識していきたいと思う。